为什么你必须掌握 API 开发?

在 AIGC 时代,会使用 ChatGPT 网页版只是基础,学会 API 开发 才是构建超级应用的起点。

无论你是想开发一个 AI 客服机器人,还是想批量处理 Excel 文档,亦或是构建自己的 AI 写作工具,一切的核心都源于同一个动作:API 调用。

很多新手被复杂的官方文档劝退,或者卡在 OpenAI API Key 的支付和网络问题上。别担心,这篇教程将提供全链路解决方案。我们将使用最流行的 Python 编程语言,带你一次性跑通全球主流大模型(OpenAI/Claude/DeepSeek)的接口。

拒绝理论空谈,我们直接上代码!

🛠️ 第一部分:开发环境搭建 (Prerequisites)

工欲善其事,必先利其器。为了顺利完成 Python 接口调用,我们需要准备以下环境。

1. Python 环境配置

确保你的电脑安装了 Python 3.8 或更高版本。

- 检查方法: 打开终端 (Terminal/CMD),输入

python --version。 - 国内加速建议: 如果你下载库很慢,建议配置清华源镜像:Bash

pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

2. 代码编辑器 (IDE)

强烈推荐使用 VS Code 配合 Cursor 插件。Cursor 是目前最强大的 AI 辅助编程工具,它能帮你自动补全 API 代码,极大降低开发门槛。

3. 获取 API Key (核心凭证)

API Key 是你调用大模型的“数字通行证”。

- 官方申请: 前往 OpenAI / DeepSeek / Anthropic 官网后台生成

sk-开头的密钥。 - 省心方案(推荐): 官方渠道通常需要海外信用卡且面临封号风险。建议使用本站推荐的 API 聚合网关,一站式获取支持 GPT-5/Claude/DeepSeek 的企业级 Key,稳定且支持支付宝支付。

![图片[1] - AI API 开发第一课:用 Python 跑通 OpenAI/Claude/DeepSeek 全主流模型接口 - 速夕Ai-Blog](https://blog.suxi.ai/wp-content/uploads/2025/12/20251227082027912-Generate_image_using_202512270818-1024x576.jpeg)

🔑 第二部分:行业标准 —— OpenAI 官方 SDK 接入实战

目前,全球 90% 的大模型(包括国内的 DeepSeek、阿里的 Qwen)都兼容 OpenAI 接口格式 (OpenAI-Compatible)。这意味着,你只要学会了下面这一套代码,就通吃大部分模型。

步骤 1:安装 Python 依赖库

在终端执行以下命令,安装官方 SDK:

pip install openai步骤 2:编写你的第一个 API 脚本

新建文件 demo_openai.py,复制以下代码。我们将演示如何通过 Python 代码 与 GPT-4o 进行对话。

import os

from openai import OpenAI

# ================= 配置区域 =================

# 建议将 Key 放入环境变量,或者直接填入下方字符串

# 如果你使用的是本站推荐的聚合网关,请务必修改 api_key 和 base_url

MY_API_KEY = "sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx"

# 官方地址:https://api.openai.com/v1

# 中转/网关地址示例:https://api.suxi.ai/v1 (请根据实际情况修改)

MY_BASE_URL = "https://api.suxi.ai/v1"

# ===========================================

# 1. 初始化 OpenAI 客户端

#这一步是 API 开发的核心,建立了你的本地代码与大模型服务器的连接

client = OpenAI(

api_key=MY_API_KEY,

base_url=MY_BASE_URL

)

print("正在尝试连接 OpenAI API,请求模型:gpt-4o ...")

try:

# 2. 发送 Chat Completion 请求

# stream=False 表示非流式输出,一次性返回所有结果

completion = client.chat.completions.create(

model="gpt-4o", # 可以在这里切换 gpt-5.2 或 gpt-5.1

messages=[

# system: 设定 AI 的人设/角色

{"role": "system", "content": "你是一个资深的 Python 开发专家,回答要专业且简洁。"},

# user: 用户的问题

{"role": "user", "content": "请用一句话解释什么是 API 接口?"}

],

temperature=0.7, # 随机性参数:0.0 最严谨,1.0 最有创意

max_tokens=500 # 限制 AI 回复的最大长度,防止消耗过多 Token

)

# 3. 解析并打印返回结果

# API 返回的是一个嵌套的 JSON 对象,我们需要提取 content 字段

reply_content = completion.choices[0].message.content

print("\n-------- AI 回复内容 --------")

print(reply_content)

print("-----------------------------")

except Exception as e:

# 捕获所有异常,方便排查 API 报错

print(f"❌ 接口调用失败,错误信息: {e}")🚀 第三部分:国产之光 —— DeepSeek V3 (深度求索) 无缝切换

DeepSeek V3 是 2024-2025 年最火的国产开源模型,在编程和逻辑能力上通过了多项 LLM 评测,且 API 价格 极其便宜。

因为它完美兼容 OpenAI SDK,我们不需要安装新库,只需要改两个参数:

- Key:换成 DeepSeek 的 Key。

- Base URL:换成 DeepSeek 官方地址。

- Model:换成

deepseek-chat。

DeepSeek 接入代码示例

新建 demo_deepseek.py:

from openai import OpenAI

# DeepSeek 官方 API 地址 (必填)

# 如果使用中转,请填中转商地址

DEEPSEEK_BASE_URL = "https://api.deepseek.com"

DEEPSEEK_API_KEY = "sk-your-deepseek-key"

client = OpenAI(

api_key=DEEPSEEK_API_KEY,

base_url=DEEPSEEK_BASE_URL

)

print("正在呼叫国产大模型 DeepSeek V3 ...")

try:

response = client.chat.completions.create(

model="deepseek-chat", # 注意:模型名称必须准确,V3版本通常用这个

messages=[

{"role": "system", "content": "You are a helpful assistant"},

{"role": "user", "content": "DeepSeek V3 相比 V2 有哪些提升?请简要概括。"},

],

temperature=1.0 # DeepSeek 建议设置较高的温度以获得更好体验

)

print(f"\n💬 DeepSeek 回复:\n{response.choices[0].message.content}")

except Exception as e:

print(f"❌ DeepSeek 调用出错: {e}")![图片[2] - AI API 开发第一课:用 Python 跑通 OpenAI/Claude/DeepSeek 全主流模型接口 - 速夕Ai-Blog](https://blog.suxi.ai/wp-content/uploads/2025/12/20251227082917618-Image_202512270828-1024x576.jpeg)

✒️ 第四部分:Claude 4.5 Sonnet —— 差异化接入

Anthropic Claude 3 系列(Opus/Sonnet/Haiku)在长文本处理和代码编写上表现优异。它的 Python SDK (anthropic) 写法与 OpenAI 略有不同,主要体现在 System Prompt 的传递方式上。

步骤 1:安装 Anthropic 库

pip install anthropic

步骤 2:Claude 接入代码

新建 demo_claude.py:

import anthropic

# Claude 目前国内直连困难,建议使用中转 Key 或配置代理

client = anthropic.Anthropic(

api_key="sk-ant-xxxxxxxxxxxxxxxxxxxx",

)

print("正在连接 Claude 4.5 Sonnet ...")

try:

message = client.messages.create(

model="claude-sonnet-4-5-20250929", # 指定具体的模型版本号

max_tokens=1000,

temperature=0.5,

# 【关键差异】Claude 的 system prompt 是一个独立参数,不在 messages 列表中

system="你是一位精通中英互译的翻译家。",

messages=[

{"role": "user", "content": "请将‘API Development’翻译成中文,并解释其含义。"}

]

)

# 【关键差异】获取结果的方式是 message.content[0].text

print(f"\n📝 Claude 回复:\n{message.content[0].text}")

except Exception as e:

print(f"❌ Claude 调用失败: {e}")🚑 第五部分:API 报错急救站 (Troubleshooting)

在 API 开发 过程中,报错是家常便饭。以下是 Python 调用大模型 时最常见的 4 种错误及其百分百解决方法。

| 错误类型 (Error Type) | 错误代码 | 可能原因 (Reason) | 解决方案 (Solution) |

| AuthenticationError | 401 | 鉴权失败。Key 填写错误、复制多了空格,或者 Key 已被官方封禁。 | 1. 检查代码中 Key 是否正确。 2. 登录 速夕Ai 购买新的稳定 Key。 |

| RateLimitError | 429 | 请求受限。账户余额不足(0余额),或者并发请求太快。 | 1. 检查 API 账户是否有余额。 2. 免费版 Key 通常限制每分钟 3 次请求,请降低频率。 |

| APITimeoutError | – | 连接超时。国内网络无法直接访问 OpenAI/Claude 官方服务器。 | 1. 开启全局魔法上网。 2. 强烈推荐:在代码中使用本站的 API 聚合网关,国内直连不丢包。 |

| NotFoundError | 404 | 模型不存在。model 参数填错了,比如把 gpt-4 写成了 gpt-4-abc。 | 查阅官方文档,确认最新的模型 ID(Model ID)。 |

🎉 总结与进阶预告

恭喜你!通过这篇教程,你已经成功迈出了 AI API 开发 的第一步。你现在拥有的能力,已经足够去编写一个简单的 AI 聊天机器人脚本了。

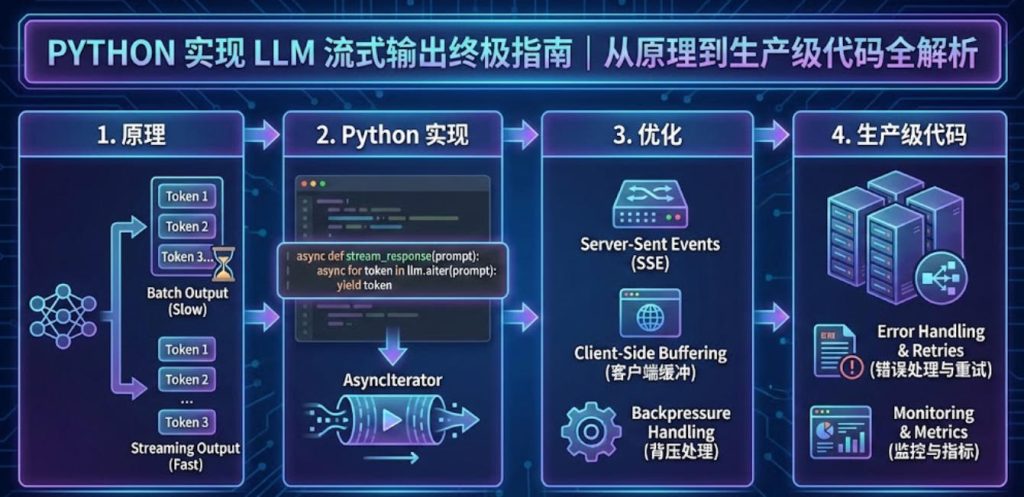

但你可能发现,AI 回复这一大段话需要等好几秒,体验不够丝滑。怎么解决?

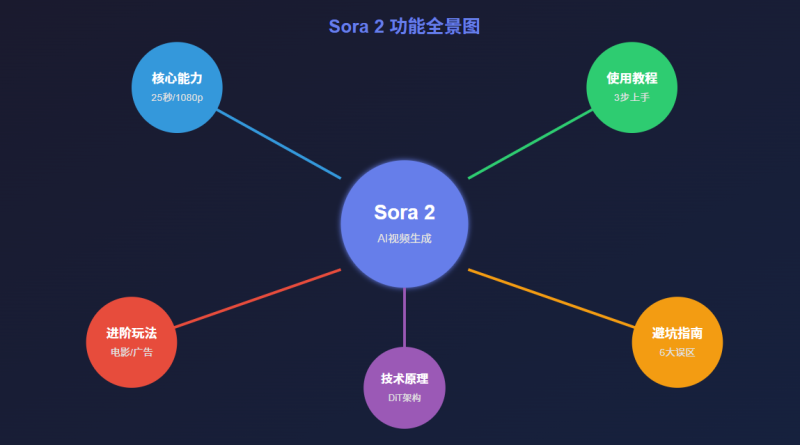

👉 下期预告: 《Python 实现 LLM 流式输出 (Streaming) 完整教程:让 AI 像打字机一样说话》 —— 我们将教你如何通过 stream=True 参数,实现 ChatGPT 官网那种逐字显示的酷炫效果。

请登录后查看评论内容